Inscription / Connexion Nouveau Sujet

Statistique

Bonjour j'ai une question concernant la justification de mes réponses.

Je vous pose le sujet :

Soit une variable aléatoire indépendantes et identiquement distribués à valeur dans A.

Soit D \subset A, on note p = P($X_1 \in D)

, on pose

Je dois dans calculer E()

E() = E(

) =

par linéarité de l'espérance

= =

Car

est identiquement distribués

= = n p

C'est une question très simple, mais je veux savoir si je justifie bien mon raisonnement.

Merci !

Par ailleurs, je dois calculer la variance mais je bloque à un moment :

V() = V(

) =

par l'indépendance des variables aléatoires

Comment continuer ? Dois-je utiliser

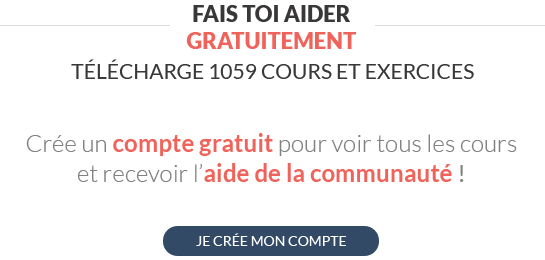

C'est correct jusque là, à un détail près*

Pour la variance, utilise , qui est bien utile ici puisque

-ps.

Donc ça fait au final.

* : tu n'as pas justifié que est intégrable avant de prendre l'éespérance. Même chose pour la variance, il faut d'abord montrer qu'elle est

. Il y a certes une convention évidente

si

. Mais que vaut la variance de la v.a ps égale à

?

Pour tout faire proprement écris simplement que : est toujours une v.a

, donc évidemment

et

, parce que P est une mesure finie. Note bien que ce n'est pas la suite qui est bornée, mais chacun de ses termes, ce qui suffit pour nous.

Merci ulmiere mais on a pas à justifié tout ce que vous avez dit car ma matière est introduction à la statistique !

Par contre je crois que ma professeur s'est alors tromper dans la correction pour V(Sn)?

Car moi aussi je trouvais np(1-np) et je ne savais pas pourquoi je n'avais pas le même résultat que dans ma correction ...?

Non, ta prof a raison et est d'accord avec moi.

J'ai bien écrit et non

Quant à la justification, elle est bien présente, dans la ligne " suit une loi de Bernoulli de paramètre p".

V() = V(

) =

par l'indépendance des variables aléatoires

=

=

=

=

Je crois avoir trouver mon erreur quand je calculais je trouvais que

mais en fait :

C'est bien ça ?

statistiques en post-bac

statistiques en post-bac